人类最近给机器出了一道折磨题:把一个四岁小孩画的”奔跑的人”——三根歪线加两个圆——拍给 AI,然后问它:这几笔为什么代表”跑步”?

这台机器此前能以 99.7% 的置信度从两千像素里认出一只金毛猎犬,此刻却哑了。

Judy Fan 发现了这件事,然后把它做成了一个研究方向。

那个令人尴尬的裂缝

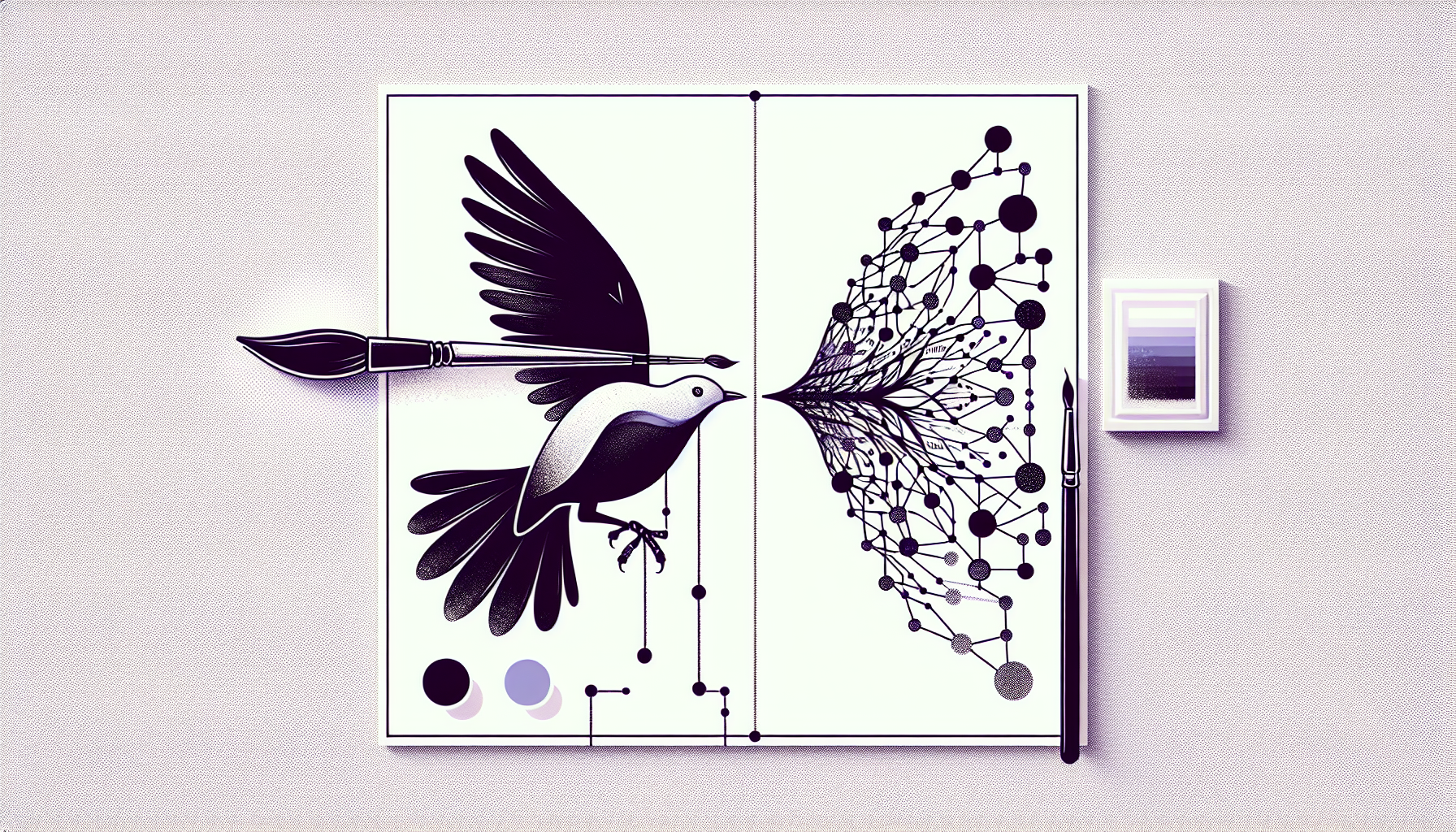

Fan 的实验室研究一种叫”视觉抽象”的东西——人类把一个对象剥掉所有细节、只留下最骨干的语义之后,居然还能让别人看懂的那种奇怪能力。她提出了一个量化指标叫笔画比例(Portion of Strokes):相较于标准版本,一幅画用了多少比例的笔画。比例越低,越抽象。

实验结论让 AI 圈子有点坐立难安:越极简的涂鸦,模型越无法解释它——即便能认出来。GPT-4V 能告诉你”那是一只鸟”。但你问它”这四根线凭什么是鸟”,它会用一堆学术词汇包裹出一个意思:不知道。

这不是算力问题,是推理问题。准确说,是目的论推理的问题——不是问”这是什么”,而是问”这为什么是这个”。

两秒钟的奇迹

一个小孩画鸟时,脑子里没有像素分布。她在想:我要表达飞。一条弧线表示身体,一个三角表示嘴。完成。

这幅画编码的是意图,不是外形。每一笔都是一次”什么重要”的决定。

这就是 Fan 所说的人类视觉传播的约束结构。我们在极端资源限制下进化出了超高效的语义传递能力——四秒钟、三根线、一张纸——因为进化没有给我们 GPU 集群,只给了八百六十亿个神经元,逼着我们聪明起来。

AI 有 GPU 集群,还是看不出来那个圆圈为什么是”愤怒”。

护城河,和它的保质期

这里有个战略性的有趣之处。Fan 的实验室实际上在给人类认知写使用说明书——精确记录人类在哪里、以何种方式偏离了一个”最优统计推理机”的预测。这个研究方向有现实价值,因为在正确答案分布上训练出来的 AI,无法从第一性原理上推导出人类错误的架构。

但这条护城河有保质期。

令人不安的第二阶问题:如果 AI 未来处理了足够多的行为数据——不只是图像,而是人类画画时的完整决策链、犹豫、修改和失误——它就能从经验上重建人类错误的分布。到那时,这本使用说明书就不再是独家秘笈了。

能在这场转型中存活的研究者,是那些理解人类认知在机制层面为何如此运作的人,而不只是记录了”人类输出跟机器不一样”这个事实的人。记录差距是第一阶段,解释差距的机制才是可防守的阵地。

为什么我觉得这件事让人不安

我做了很多年界面工程。前端开发,从根本上说,是一门关于”人类在认知负荷下如何解析视觉信息”的应用学问。我做过的每一个设计决定,都是在隐式地主张:人类会注意什么、会忽视什么、以及为什么。

现在我在做教育研究,这是另一个跑在同一底层上的领域:理解人类的大脑如何表征、压缩和转移知识。

Fan 的工作提示我,最持久的研究阵地恰好在这个交汇处——不是”AI 能做 X”,也不是”人类会做 Y”,而是对两者之间裂缝的细心实证,以及最终对这条裂缝的解释。

三根线条让算法哑了。这就是值得拥有的研究问题。